Møllergata 6-8

0179 Oslo

Norge

Google gikk den 25. oktober ut med at de har introdusert BERT, som står for Bidirectional Encoder Representations from Transformers, i søkemotoren sin. Google nevner selv at dette er et av de største fremstegene de har gjort med algoritmene sine på over fem år. Samtidig som de gjør fremsteg ser vi også at teknologien innen AI og maskinlæring forbedres ytterligere og vil bli enda mer viktig inn i 2020.

Den nyeste oppdateringen til Google er kort oppsummert noe som skal sørge for at brukere møter søkeintensjonen sin oftere enn før, og er ikke noe som man nødvendigvis kan optimalisere for. Utenom å produsere innhold som møter søkeintensjoner og som er av relativ god verdi for brukerne, er dette kun en oppdatering som betyr at Google er blitt flinkere til å forstå hvilket innhold søkeren vil ha.

Algoritmeendringen vil gjøre det lettere for Google å forstå innhold på nettet og gi et mer relevant resultat til søkerne enn tidligere. Ved å ta i bruk en bredere forståelse av preposisjoner i setninger det blir søkt på, vil BERT påvirke resultatet av spesielt lengre søkefraser og eventuelt talesøk.

Preposisjoner som «i», «på» og «før» er ord som sier noe om hvordan noe er plassert i forhold til noe annet, og kan ha en stor betydning for hva som er ment med en setning og hva søkeintensjonen er. Dette betyr at man, i større grad, kan bli belønnet for brukervennlig innhold. Algoritmene til Google tar større steg når det gjelder å forstå det naturlige språket og innhold som reflekterer dette kan få en høyere rangering i søkeresultater på mer relevante søk.

Enn så lenge påvirker BERT-oppdateringen kun featured snippets i Norge, men det er på agendaen at dette også blir implementert i det organiske søket fremover.

Oppdatering: 10.12.2019 bekreftet Google på sin twitterbruker, Google SearchLiaison, at Bert nå vil «rulles ut» i over 70 land. Dette inkluderer Norge, Sverige og Danmark. Det vil si at Google allerede er blitt bedre på å forstå det lokale språket.

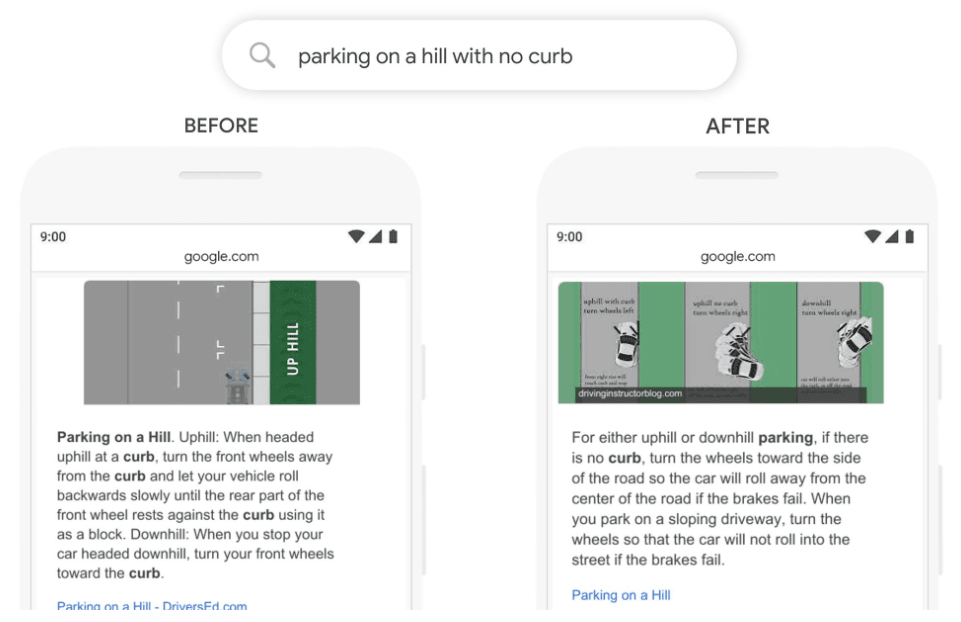

For å vise hvordan denne oppdateringen ser ut i søkeresultatet, kan vi se på Google sitt eksempel nedenfor. Eksempelet viser et søkeresultat for å parkere i en oppoverbakke uten fortau. Før oppdateringen la Google mer vekt på ordet «curb» og ignorerte ordet «no», noe som førte til at svaret som kom opp i en featured snippet var av liten nytte for brukeren.

Har du spørsmål til den nye oppdateringen fra Google, eller ønsker hjelp til å finne ut hvordan din bedrift kan forbedre synligheten i søkemotorer, ønsker vi deg velkommen til å ta kontakt med oss eller bli bedre kjent med oss ved å lese mer om hva vi gjør.